备注

点击 这里 下载完整示例代码

TorchRL 目标: 编写 DDPG 损失¶

Created On: Aug 14, 2023 | Last Updated: Mar 20, 2025 | Last Verified: Not Verified

作者: Vincent Moens

概述¶

TorchRL 将RL算法的训练拆分成多个部分,这些部分将在您的训练脚本中组装:环境、数据收集与存储、模型以及损失函数。

TorchRL 损失(或称“目标”)是包含可训练参数(策略和价值模型)的有状态对象。本教程将指导您从头编写一个使用 TorchRL 的损失模块。

为此,我们将专注于 DDPG,它是一个相对容易编码的算法。深度确定性策略梯度 (DDPG) 是一个简单的连续控制算法。它包括学习一个参数化的值函数,用于动作-观测对,然后学习一个策略,使其输出的动作能够在给定特定观测的情况下最大化该值函数。

您将学习到:

如何编写损失模块并自定义其值估计器;

如何使用 TorchRL 构建环境,包括变换(例如数据归一化)和并行执行;

如何设计策略和价值网络;

如何高效地从环境中收集数据,并将其存储在回放缓冲区中;

如何在回放缓冲区中存储轨迹(而不是过渡数据);

如何评估您的模型。

导入和设置¶

%%bash pip3 install torchrl mujoco glfw

import torch

import tqdm

我们将在支持 CUDA 的情况下在 CUDA 上执行策略

is_fork = multiprocessing.get_start_method() == "fork"

device = (

torch.device(0)

if torch.cuda.is_available() and not is_fork

else torch.device("cpu")

)

collector_device = torch.device("cpu") # Change the device to ``cuda`` to use CUDA

TorchRL LossModule¶

TorchRL 提供了一系列可用于训练脚本的损失模块。目标是拥有易于重用/替换且具有简单签名的损失模块。

TorchRL 损失的主要特征是:

它们是有状态对象:它们包含可训练参数的副本,因此

loss_module.parameters()返回训练算法所需的所有参数。它们遵循

TensorDict约定:torch.nn.Module.forward()方法将接收包含所有必要信息以返回损失值的 TensorDict 作为输入。>>> data = replay_buffer.sample() >>> loss_dict = loss_module(data)

它们输出一个

tensordict.TensorDict实例,其中损失值以"loss_<smth>"为键写入,其中smth是描述损失的字符串。在TensorDict中的其他键可能是训练期间记录的有用指标。备注

返回单独的损失的原因是,为了让用户可以对不同参数集使用不同的优化器。例如,可以通过简单求和来合并这些损失。

>>> loss_val = sum(loss for key, loss in loss_dict.items() if key.startswith("loss_"))

``__init__``方法¶

所有损失的父类是 LossModule。与库的许多其他组件一样,其 forward() 方法期望从经验回放缓冲区或任何类似数据结构中采样的 tensordict.TensorDict 实例作为输入。使用这种格式可以让模块跨模态重用,或在复杂设置中(例如模型需要读取多个条目的情况)使用。换句话说,它允许我们编写一个对给定数据类型无感的损失模块,仅专注于运行损失函数的基本步骤。

为了使教程尽可能具有教学性,我们将单独显示类的每个方法,并在后续阶段填充该类。

让我们从 __init__() 方法开始。DDPG 旨在通过一种简单策略解决控制任务:训练一个策略,以输出最大化价值网络预测价值的动作。因此,我们的损失模块需要在其构造函数中接收两个网络:一个为 actor 网络,另一个为价值网络。我们期望这两个网络都是与 TensorDict 兼容的对象,例如 tensordict.nn.TensorDictModule。我们的损失函数需要计算目标值并使价值网络拟合这个目标值,并生成一个动作并使策略拟合以最大化其价值估计。

LossModule.__init__() 方法的关键步骤是调用 convert_to_functional()。此方法会从模块中提取参数并将其转换为功能模块。从严格意义上讲,这不是必须的,可以完全不使用它来编码所有损失。然而,我们鼓励使用它,原因如下。

TorchRL 这样做的原因是,RL 算法通常使用不同参数集(称为“可训练”和“目标”参数)多次执行相同模型。“可训练”参数是优化器需要拟合的参数。而“目标”参数通常是前者的副本,并有一定时间滞后(绝对或通过移动平均稀释)。这些目标参数用于计算与下一个观测相关的价值。使用一组与当前配置不完全匹配的目标参数的优点之一是,它们为计算的价值函数提供一个悲观的界限。请注意下面的 create_target_params 关键字参数:此参数告诉 convert_to_functional() 方法在损失模块中创建一组目标参数以用于目标值计算。如果设置为 False``(例如 actor 网络),``target_actor_network_params 属性将仍然可访问,但这将仅返回 actor 参数的 分离 版本。

稍后,我们将讨论如何在 TorchRL 中更新目标参数。

from tensordict.nn import TensorDictModule, TensorDictSequential

def _init(

self,

actor_network: TensorDictModule,

value_network: TensorDictModule,

) -> None:

super(type(self), self).__init__()

self.convert_to_functional(

actor_network,

"actor_network",

create_target_params=True,

)

self.convert_to_functional(

value_network,

"value_network",

create_target_params=True,

compare_against=list(actor_network.parameters()),

)

self.actor_in_keys = actor_network.in_keys

# Since the value we'll be using is based on the actor and value network,

# we put them together in a single actor-critic container.

actor_critic = ActorCriticWrapper(actor_network, value_network)

self.actor_critic = actor_critic

self.loss_function = "l2"

价值估计器损失方法¶

在许多 RL 算法中,价值网络(或 Q 值网络)的训练基于经验值估计。它可以是自举的(TD(0),低方差,高偏差),这意味着目标值是通过下一个奖励获得的,或者可以是蒙特卡罗估计(TD(1)),在这种情况下,要使用即将到来的奖励序列(高方差,低偏差)。也可以使用中间估计器(TD(\(\lambda\)))来权衡偏差和方差。TorchRL 通过 ValueEstimators 枚举类方便地实现了这些估计器,它包含所有价值估计器的指针。让我们在这里定义默认值函数。我们将选择最简单的版本(TD(0)),并在后面展示如何更改此设置。

from torchrl.objectives.utils import ValueEstimators

default_value_estimator = ValueEstimators.TD0

我们还需要向 DDPG 提供一些如何构建价值估计器的指令,这取决于用户的需求。根据提供的估计器,我们将构建相应的模块以在训练时使用:

from torchrl.objectives.utils import default_value_kwargs

from torchrl.objectives.value import TD0Estimator, TD1Estimator, TDLambdaEstimator

def make_value_estimator(self, value_type: ValueEstimators, **hyperparams):

hp = dict(default_value_kwargs(value_type))

if hasattr(self, "gamma"):

hp["gamma"] = self.gamma

hp.update(hyperparams)

value_key = "state_action_value"

if value_type == ValueEstimators.TD1:

self._value_estimator = TD1Estimator(value_network=self.actor_critic, **hp)

elif value_type == ValueEstimators.TD0:

self._value_estimator = TD0Estimator(value_network=self.actor_critic, **hp)

elif value_type == ValueEstimators.GAE:

raise NotImplementedError(

f"Value type {value_type} it not implemented for loss {type(self)}."

)

elif value_type == ValueEstimators.TDLambda:

self._value_estimator = TDLambdaEstimator(value_network=self.actor_critic, **hp)

else:

raise NotImplementedError(f"Unknown value type {value_type}")

self._value_estimator.set_keys(value=value_key)

make_value_estimator 方法可以调用,也可以不调用:如果不调用,LossModule 将使用其默认估计器自行查询。

actor 损失方法¶

一个 RL 算法的核心部分是 actor 的训练损失。在 DDPG 的情况下,此功能相当简单:我们只需计算使用策略计算的一个动作相关的值,并优化 actor 权重以最大化该值。

在计算此值时,我们必须确保将价值参数从计算图中移除,否则 actor 和价值损失会混在一起。为此,可以使用 hold_out_params() 函数。

def _loss_actor(

self,

tensordict,

) -> torch.Tensor:

td_copy = tensordict.select(*self.actor_in_keys)

# Get an action from the actor network: since we made it functional, we need to pass the params

with self.actor_network_params.to_module(self.actor_network):

td_copy = self.actor_network(td_copy)

# get the value associated with that action

with self.value_network_params.detach().to_module(self.value_network):

td_copy = self.value_network(td_copy)

return -td_copy.get("state_action_value")

价值损失方法¶

我们现在需要优化我们的价值网络参数。为此,我们将依赖于我们类的价值估计器:

from torchrl.objectives.utils import distance_loss

def _loss_value(

self,

tensordict,

):

td_copy = tensordict.clone()

# V(s, a)

with self.value_network_params.to_module(self.value_network):

self.value_network(td_copy)

pred_val = td_copy.get("state_action_value").squeeze(-1)

# we manually reconstruct the parameters of the actor-critic, where the first

# set of parameters belongs to the actor and the second to the value function.

target_params = TensorDict(

{

"module": {

"0": self.target_actor_network_params,

"1": self.target_value_network_params,

}

},

batch_size=self.target_actor_network_params.batch_size,

device=self.target_actor_network_params.device,

)

with target_params.to_module(self.actor_critic):

target_value = self.value_estimator.value_estimate(tensordict).squeeze(-1)

# Computes the value loss: L2, L1 or smooth L1 depending on `self.loss_function`

loss_value = distance_loss(pred_val, target_value, loss_function=self.loss_function)

td_error = (pred_val - target_value).pow(2)

return loss_value, td_error, pred_val, target_value

将各部分结合到一个 forward 调用中¶

唯一缺少的部分是 forward 方法,它将粘合价值和 actor 损失,收集成本值并将其写入提供给用户的 TensorDict 中。

from tensordict import TensorDict, TensorDictBase

def _forward(self, input_tensordict: TensorDictBase) -> TensorDict:

loss_value, td_error, pred_val, target_value = self.loss_value(

input_tensordict,

)

td_error = td_error.detach()

td_error = td_error.unsqueeze(input_tensordict.ndimension())

if input_tensordict.device is not None:

td_error = td_error.to(input_tensordict.device)

input_tensordict.set(

"td_error",

td_error,

inplace=True,

)

loss_actor = self.loss_actor(input_tensordict)

return TensorDict(

source={

"loss_actor": loss_actor.mean(),

"loss_value": loss_value.mean(),

"pred_value": pred_val.mean().detach(),

"target_value": target_value.mean().detach(),

"pred_value_max": pred_val.max().detach(),

"target_value_max": target_value.max().detach(),

},

batch_size=[],

)

from torchrl.objectives import LossModule

class DDPGLoss(LossModule):

default_value_estimator = default_value_estimator

make_value_estimator = make_value_estimator

__init__ = _init

forward = _forward

loss_value = _loss_value

loss_actor = _loss_actor

现在我们有了我们的损失,我们可以用它来训练一个政策以解决控制任务。

环境¶

在大多数算法中,首先需要处理的是环境的构建,因为它影响其余训练脚本。

在本示例中,我们将使用 "cheetah" 任务。目标是让一个半猎豹尽可能快地奔跑。

在 TorchRL 中,可以通过依赖 dm_control 或 gym 来创建这样的任务:

env = GymEnv("HalfCheetah-v4")

或者

env = DMControlEnv("cheetah", "run")

默认情况下,这些环境禁用了渲染。从状态进行训练通常比从图像进行训练更容易。为使事情简单,我们专注于仅从状态进行学习。要将像素传递到 env.step() 收集的 tensordicts 中,只需将 from_pixels=True 参数传递给构造函数:

env = GymEnv("HalfCheetah-v4", from_pixels=True, pixels_only=True)

我们编写了一个 make_env() 帮助函数,它将创建一个使用上述两个后端之一(dm-control 或 gym)的环境。

from torchrl.envs.libs.dm_control import DMControlEnv

from torchrl.envs.libs.gym import GymEnv

env_library = None

env_name = None

def make_env(from_pixels=False):

"""Create a base ``env``."""

global env_library

global env_name

if backend == "dm_control":

env_name = "cheetah"

env_task = "run"

env_args = (env_name, env_task)

env_library = DMControlEnv

elif backend == "gym":

env_name = "HalfCheetah-v4"

env_args = (env_name,)

env_library = GymEnv

else:

raise NotImplementedError

env_kwargs = {

"device": device,

"from_pixels": from_pixels,

"pixels_only": from_pixels,

"frame_skip": 2,

}

env = env_library(*env_args, **env_kwargs)

return env

变换¶

现在我们有了一个基础环境,我们可能希望修改其表示形式以使其更易于策略使用。在 TorchRL 中,变换被追加到一个专门的 torchr.envs.TransformedEnv 类的基础环境中。

在 DDPG 中,通常会根据某种启发式值重新缩放奖励。在本示例中,我们将奖励乘以 5。

如果我们使用

dm_control,还需要在模拟器(使用双精度数值)与我们的脚本(假定使用单精度数值)之间构建一个接口。这种转换是双向的:调用env.step()时,我们的动作需要用双精度表示,而输出需要转换为单精度。DoubleToFloat转换正是这么做的:in_keys列表表示需要从双精度转换为单精度的键,而in_keys_inv表示需要在传递给环境之前从单精度转换为双精度的键。我们使用

CatTensors转换将状态键连接在一起。最后,我们还保留了归一化状态的可能性:稍后我们将负责计算归一化常数。

from torchrl.envs import (

CatTensors,

DoubleToFloat,

EnvCreator,

InitTracker,

ObservationNorm,

ParallelEnv,

RewardScaling,

StepCounter,

TransformedEnv,

)

def make_transformed_env(

env,

):

"""Apply transforms to the ``env`` (such as reward scaling and state normalization)."""

env = TransformedEnv(env)

# we append transforms one by one, although we might as well create the

# transformed environment using the `env = TransformedEnv(base_env, transforms)`

# syntax.

env.append_transform(RewardScaling(loc=0.0, scale=reward_scaling))

# We concatenate all states into a single "observation_vector"

# even if there is a single tensor, it'll be renamed in "observation_vector".

# This facilitates the downstream operations as we know the name of the

# output tensor.

# In some environments (not half-cheetah), there may be more than one

# observation vector: in this case this code snippet will concatenate them

# all.

selected_keys = list(env.observation_spec.keys())

out_key = "observation_vector"

env.append_transform(CatTensors(in_keys=selected_keys, out_key=out_key))

# we normalize the states, but for now let's just instantiate a stateless

# version of the transform

env.append_transform(ObservationNorm(in_keys=[out_key], standard_normal=True))

env.append_transform(DoubleToFloat())

env.append_transform(StepCounter(max_frames_per_traj))

# We need a marker for the start of trajectories for our Ornstein-Uhlenbeck (OU)

# exploration:

env.append_transform(InitTracker())

return env

并行执行¶

以下辅助函数允许我们并行运行环境。并行运行环境可以显著提高数据收集的吞吐量。使用转换环境时,我们需要选择是单独为每个环境执行转换,还是将数据集中起来并批量转换。两种方法都容易实现:

env = ParallelEnv(

lambda: TransformedEnv(GymEnv("HalfCheetah-v4"), transforms),

num_workers=4

)

env = TransformedEnv(

ParallelEnv(lambda: GymEnv("HalfCheetah-v4"), num_workers=4),

transforms

)

为了利用 PyTorch 的矢量化能力,我们采用第一种方法:

def parallel_env_constructor(

env_per_collector,

transform_state_dict,

):

if env_per_collector == 1:

def make_t_env():

env = make_transformed_env(make_env())

env.transform[2].init_stats(3)

env.transform[2].loc.copy_(transform_state_dict["loc"])

env.transform[2].scale.copy_(transform_state_dict["scale"])

return env

env_creator = EnvCreator(make_t_env)

return env_creator

parallel_env = ParallelEnv(

num_workers=env_per_collector,

create_env_fn=EnvCreator(lambda: make_env()),

create_env_kwargs=None,

pin_memory=False,

)

env = make_transformed_env(parallel_env)

# we call `init_stats` for a limited number of steps, just to instantiate

# the lazy buffers.

env.transform[2].init_stats(3, cat_dim=1, reduce_dim=[0, 1])

env.transform[2].load_state_dict(transform_state_dict)

return env

# The backend can be ``gym`` or ``dm_control``

backend = "gym"

备注

frame_skip 将多个步骤批量处理为一个动作。如果 frame_skip > 1,其他帧计数(如 frames_per_batch 和 total_frames)需要调整,以在实验中收集一致的总帧数。这一点很重要,增加 frame-skip 而保持总帧数不变可能看起来像作弊:综合比较一下,使用 frame-skip 为 2 的数据集和使用 frame-skip 为 1 的数据集的环境交互次数实际上为 2:1!简而言之,在处理帧跳过时,应该谨慎处理训练脚本的帧计数,因为这可能导致训练策略之间的比较产生偏差。

调整奖励有助于我们控制信号的幅度,从而实现更高效的学习。

reward_scaling = 5.0

我们还定义了何时截断一个轨迹。对猎豹任务而言,一千步(frame-skip = 2 时为 500 步)是一个合适的数字:

max_frames_per_traj = 500

观察值的归一化¶

为了计算归一化统计数据,我们在环境中运行任意数量的随机步,并计算收集到的观察值的均值和标准差。可以使用 ObservationNorm.init_stats() 方法完成此操作。为了获得汇总统计数据,我们创建一个虚拟环境并运行指定数量的步,收集数据并计算其汇总统计。

def get_env_stats():

"""Gets the stats of an environment."""

proof_env = make_transformed_env(make_env())

t = proof_env.transform[2]

t.init_stats(init_env_steps)

transform_state_dict = t.state_dict()

proof_env.close()

return transform_state_dict

归一化统计¶

使用 ObservationNorm 作为统计计算的随机步数量

init_env_steps = 5000

transform_state_dict = get_env_stats()

每个数据收集器中的环境数量

env_per_collector = 4

我们将之前计算的统计数据传递给归一化我们的环境输出:

parallel_env = parallel_env_constructor(

env_per_collector=env_per_collector,

transform_state_dict=transform_state_dict,

)

from torchrl.data import CompositeSpec

构建模型¶

现在我们开始设置模型。如我们所见,DDPG 需要一个值网络,用于估计状态-动作对的值;还需要一个参数化的actor,它学习如何选择最大化值的动作。

请记住,构建一个 TorchRL 模块需要两个步骤:

编写将用作网络的

torch.nn.Module,将网络包装在

tensordict.nn.TensorDictModule中,其中通过指定输入和输出键来处理数据流。

在更复杂的情况下,还可以使用 tensordict.nn.TensorDictSequential。

Q-值网络被包装在 ValueOperator 中,该操作会自动将 out_keys 设置为 ``”state_action_value``(用于 Q 值网络)和 ``state_value``(用于其他值网络)。

TorchRL 提供了论文中介绍的 DDPG 网络的内置版本。这些可以通过 DdpgMlpActor 和 DdpgMlpQNet 找到。

由于我们使用惰性模块,所以在能够将策略从设备移动到设备并执行其他操作之前,必须实现惰性模块。因此,建议用一小部分数据运行模块。为此,我们从环境规格中生成伪数据。

from torchrl.modules import (

ActorCriticWrapper,

DdpgMlpActor,

DdpgMlpQNet,

OrnsteinUhlenbeckProcessModule,

ProbabilisticActor,

TanhDelta,

ValueOperator,

)

def make_ddpg_actor(

transform_state_dict,

device="cpu",

):

proof_environment = make_transformed_env(make_env())

proof_environment.transform[2].init_stats(3)

proof_environment.transform[2].load_state_dict(transform_state_dict)

out_features = proof_environment.action_spec.shape[-1]

actor_net = DdpgMlpActor(

action_dim=out_features,

)

in_keys = ["observation_vector"]

out_keys = ["param"]

actor = TensorDictModule(

actor_net,

in_keys=in_keys,

out_keys=out_keys,

)

actor = ProbabilisticActor(

actor,

distribution_class=TanhDelta,

in_keys=["param"],

spec=CompositeSpec(action=proof_environment.action_spec),

).to(device)

q_net = DdpgMlpQNet()

in_keys = in_keys + ["action"]

qnet = ValueOperator(

in_keys=in_keys,

module=q_net,

).to(device)

# initialize lazy modules

qnet(actor(proof_environment.reset().to(device)))

return actor, qnet

actor, qnet = make_ddpg_actor(

transform_state_dict=transform_state_dict,

device=device,

)

探索¶

策略被传递到 OrnsteinUhlenbeckProcessModule 探索模块中,正如原始论文所建议的。接下来定义 OU 噪声达到最小值之前的帧数

annealing_frames = 1_000_000

actor_model_explore = TensorDictSequential(

actor,

OrnsteinUhlenbeckProcessModule(

spec=actor.spec.clone(),

annealing_num_steps=annealing_frames,

).to(device),

)

if device == torch.device("cpu"):

actor_model_explore.share_memory()

数据收集器¶

TorchRL 提供了专门的类,用于通过在环境中执行策略来帮助您收集数据。这些”数据收集器”迭代地计算在特定时间点要执行的动作,然后在环境中执行一步操作并在需要时重置环境。数据收集器设计用于帮助开发人员严格控制每批数据的帧数量、数据收集的同步/异步性质以及分配给数据收集的资源(例如 GPU、工作者数量等)。

这里我们将使用 SyncDataCollector,一个简单的单进程数据收集器。TorchRL 提供了其他收集器,例如 MultiaSyncDataCollector,它以异步方式执行数据游走(例如,在优化策略时收集数据,从而解耦训练与数据收集)。

需要指定的参数有:

一个环境工厂或环境,

策略,

在收集器被认为为空之前的总帧数,

每个轨迹的最大帧数(对于非终止环境,如

dm_control)。备注

传递给收集器的

max_frames_per_traj将使推理所使用的环境注册一个新的StepCounter转换。我们可以像本脚本中这样手动实现同样的效果。

还应传递:

每批收集的帧数,

独立于策略执行的随机步数量,

用于策略执行的设备,

在数据传递给主进程之前用于存储数据的设备。

训练期间我们将使用的总帧数应约为 1 百万。

total_frames = 10_000 # 1_000_000

收集器在外部循环的每次迭代中返回的帧数等于每个子轨迹的长度乘以每个收集器中并行运行的环境数量。

换句话说,我们期望来自收集器的批次形状为 [env_per_collector, traj_len],其中 traj_len=frames_per_batch/env_per_collector:

traj_len = 200

frames_per_batch = env_per_collector * traj_len

init_random_frames = 5000

num_collectors = 2

from torchrl.collectors import SyncDataCollector

from torchrl.envs import ExplorationType

collector = SyncDataCollector(

parallel_env,

policy=actor_model_explore,

total_frames=total_frames,

frames_per_batch=frames_per_batch,

init_random_frames=init_random_frames,

reset_at_each_iter=False,

split_trajs=False,

device=collector_device,

exploration_type=ExplorationType.RANDOM,

)

评估器:构建您的记录器对象¶

由于训练数据是通过某种探索策略获得的,我们的算法的真实性能需要在确定性模式下进行评估。我们使用一个专门的类 Recorder 来完成这一点,它根据给定频率在环境中执行策略并返回从这些模拟中获得的统计数据。

以下辅助函数将构建该对象:

from torchrl.trainers import Recorder

def make_recorder(actor_model_explore, transform_state_dict, record_interval):

base_env = make_env()

environment = make_transformed_env(base_env)

environment.transform[2].init_stats(

3

) # must be instantiated to load the state dict

environment.transform[2].load_state_dict(transform_state_dict)

recorder_obj = Recorder(

record_frames=1000,

policy_exploration=actor_model_explore,

environment=environment,

exploration_type=ExplorationType.DETERMINISTIC,

record_interval=record_interval,

)

return recorder_obj

我们将每收集 10 批次记录一次性能

record_interval = 10

recorder = make_recorder(

actor_model_explore, transform_state_dict, record_interval=record_interval

)

from torchrl.data.replay_buffers import (

LazyMemmapStorage,

PrioritizedSampler,

RandomSampler,

TensorDictReplayBuffer,

)

回放缓冲区¶

回放缓冲区有两种类型:优先级(某些误差信号用于赋予某些条目比其他条目更高的采样概率)和常规循环经验回放。

TorchRL 的回放缓冲区是可组合的:可以选择存储、采样和写入策略。还可以使用内存映射数组将张量存储在物理内存中。以下函数负责创建具有所需超参数的回放缓冲区:

from torchrl.envs import RandomCropTensorDict

def make_replay_buffer(buffer_size, batch_size, random_crop_len, prefetch=3, prb=False):

if prb:

sampler = PrioritizedSampler(

max_capacity=buffer_size,

alpha=0.7,

beta=0.5,

)

else:

sampler = RandomSampler()

replay_buffer = TensorDictReplayBuffer(

storage=LazyMemmapStorage(

buffer_size,

scratch_dir=buffer_scratch_dir,

),

batch_size=batch_size,

sampler=sampler,

pin_memory=False,

prefetch=prefetch,

transform=RandomCropTensorDict(random_crop_len, sample_dim=1),

)

return replay_buffer

我们将在磁盘的临时目录中存储回放缓冲区

import tempfile

tmpdir = tempfile.TemporaryDirectory()

buffer_scratch_dir = tmpdir.name

回放缓冲区存储和批大小¶

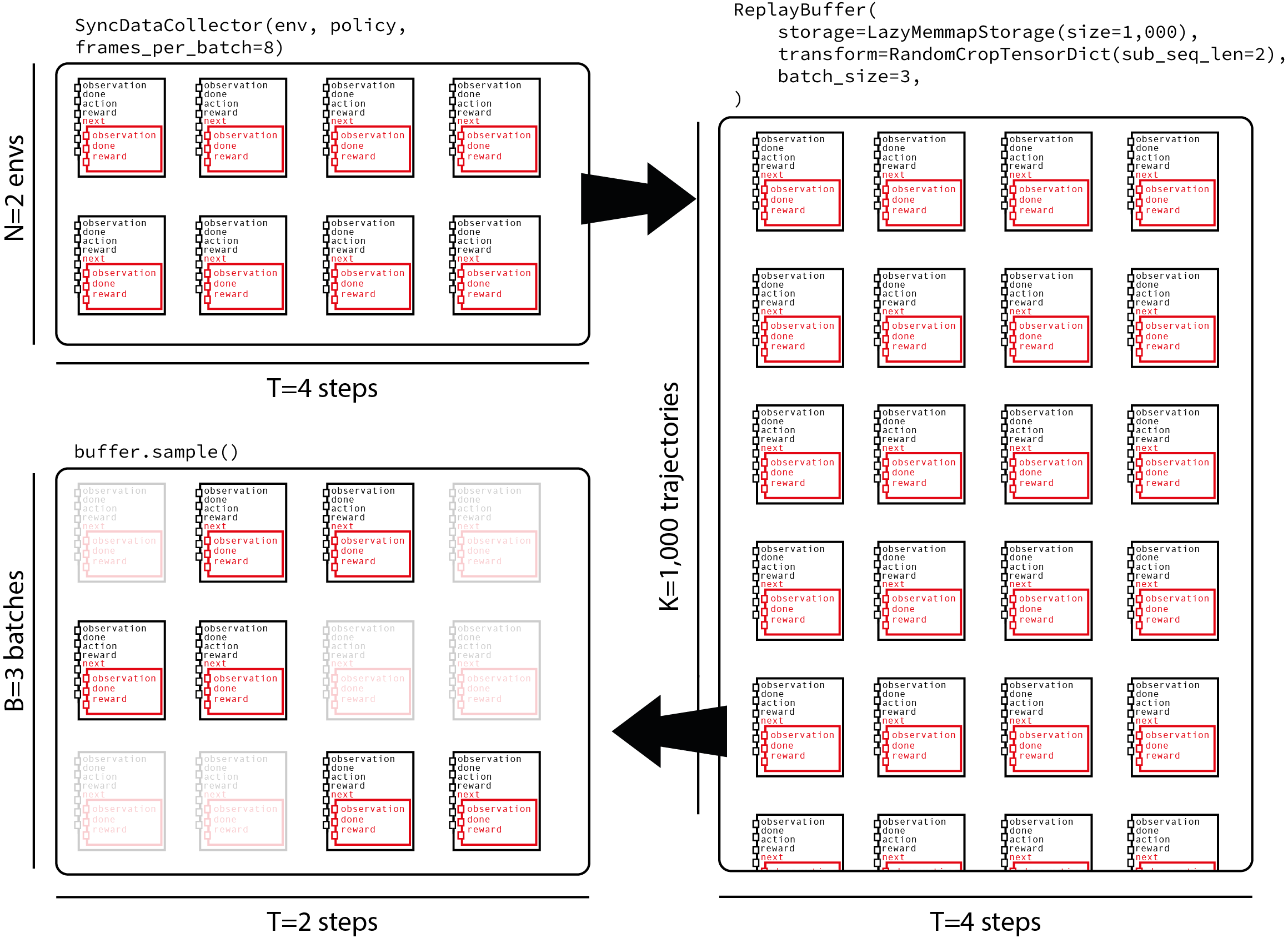

TorchRL 回放缓冲区沿第一个维度计数元素数量。由于我们将向缓冲区馈送轨迹,因此我们需要通过将缓冲区大小除以数据收集器生成的子轨迹长度来调整缓冲区大小。关于批大小,我们的采样策略将包括在选择用于计算损失的长度为 random_crop_len=25 的子轨迹之前,采样长度为 traj_len=200 的轨迹。这一策略平衡了存储一定长度的完整轨迹与为损失提供具有足够异质性的样本之间的选择。以下图展示了一个数据流,在并行运行 2 个环境的收集器中,每批收集 8 帧,将这些帧馈送至包含 1000 个轨迹的回放缓冲区,并对每 2 个时间步的子轨迹进行采样。

从缓冲区中存储的帧数量开始

def ceil_div(x, y):

return -x // (-y)

buffer_size = 1_000_000

buffer_size = ceil_div(buffer_size, traj_len)

优先回放缓冲区默认情况下是禁用的

prb = False

我们还需要定义每批收集的数据要进行的更新次数。这称为更新对数据的比率(UTD 比率):

update_to_data = 64

我们将向损失馈送长度为 25 的轨迹:

random_crop_len = 25

在原始论文中,作者使用一批 64 个元素进行一次更新,用于每收集到的帧。在这里,我们再现相同的更新对帧比率,但在每批数据收集时进行多次更新。我们调整批大小以实现相同的更新对帧比率:

batch_size = ceil_div(64 * frames_per_batch, update_to_data * random_crop_len)

replay_buffer = make_replay_buffer(

buffer_size=buffer_size,

batch_size=batch_size,

random_crop_len=random_crop_len,

prefetch=3,

prb=prb,

)

损失模块构建¶

我们使用刚才创建的 actor 和 qnet 构建我们的损失模块。由于我们有目标参数需要更新,_必须_创建目标网络更新器。

gamma = 0.99

lmbda = 0.9

tau = 0.001 # Decay factor for the target network

loss_module = DDPGLoss(actor, qnet)

让我们使用 TD(lambda)估算器!

loss_module.make_value_estimator(ValueEstimators.TDLambda, gamma=gamma, lmbda=lmbda, device=device)

备注

离线策略通常使用 TD(0) 估算器。这里,我们使用 TD(\(\lambda\)) 估算器,这将引入一些偏差,因为遵循某种状态的轨迹是用过期策略收集的。这一技巧,以及可以在数据收集期间使用的多步技巧,是通常发现尽管会引入偏差但在实际中提供良好效果的”小窍门”的替代版本。

目标网络更新器¶

目标网络是离线策略强化学习算法的重要部分。更新目标网络参数在 HardUpdate 和 SoftUpdate 类的帮助下变得简单。它们以损失模块作为参数构建,通过在训练循环中的适当位置调用 updater.step() 方法进行更新。

from torchrl.objectives.utils import SoftUpdate

target_net_updater = SoftUpdate(loss_module, eps=1 - tau)

优化器¶

最后,我们将使用 Adam 优化器对策略和值网络进行优化:

from torch import optim

optimizer_actor = optim.Adam(

loss_module.actor_network_params.values(True, True), lr=1e-4, weight_decay=0.0

)

optimizer_value = optim.Adam(

loss_module.value_network_params.values(True, True), lr=1e-3, weight_decay=1e-2

)

total_collection_steps = total_frames // frames_per_batch

开始训练策略¶

现在我们已经构建了所需的所有模块,训练循环非常直接。

rewards = []

rewards_eval = []

# Main loop

collected_frames = 0

pbar = tqdm.tqdm(total=total_frames)

r0 = None

for i, tensordict in enumerate(collector):

# update weights of the inference policy

collector.update_policy_weights_()

if r0 is None:

r0 = tensordict["next", "reward"].mean().item()

pbar.update(tensordict.numel())

# extend the replay buffer with the new data

current_frames = tensordict.numel()

collected_frames += current_frames

replay_buffer.extend(tensordict.cpu())

# optimization steps

if collected_frames >= init_random_frames:

for _ in range(update_to_data):

# sample from replay buffer

sampled_tensordict = replay_buffer.sample().to(device)

# Compute loss

loss_dict = loss_module(sampled_tensordict)

# optimize

loss_dict["loss_actor"].backward()

gn1 = torch.nn.utils.clip_grad_norm_(

loss_module.actor_network_params.values(True, True), 10.0

)

optimizer_actor.step()

optimizer_actor.zero_grad()

loss_dict["loss_value"].backward()

gn2 = torch.nn.utils.clip_grad_norm_(

loss_module.value_network_params.values(True, True), 10.0

)

optimizer_value.step()

optimizer_value.zero_grad()

gn = (gn1**2 + gn2**2) ** 0.5

# update priority

if prb:

replay_buffer.update_tensordict_priority(sampled_tensordict)

# update target network

target_net_updater.step()

rewards.append(

(

i,

tensordict["next", "reward"].mean().item(),

)

)

td_record = recorder(None)

if td_record is not None:

rewards_eval.append((i, td_record["r_evaluation"].item()))

if len(rewards_eval) and collected_frames >= init_random_frames:

target_value = loss_dict["target_value"].item()

loss_value = loss_dict["loss_value"].item()

loss_actor = loss_dict["loss_actor"].item()

rn = sampled_tensordict["next", "reward"].mean().item()

rs = sampled_tensordict["next", "reward"].std().item()

pbar.set_description(

f"reward: {rewards[-1][1]: 4.2f} (r0 = {r0: 4.2f}), "

f"reward eval: reward: {rewards_eval[-1][1]: 4.2f}, "

f"reward normalized={rn :4.2f}/{rs :4.2f}, "

f"grad norm={gn: 4.2f}, "

f"loss_value={loss_value: 4.2f}, "

f"loss_actor={loss_actor: 4.2f}, "

f"target value: {target_value: 4.2f}"

)

# update the exploration strategy

actor_model_explore[1].step(current_frames)

collector.shutdown()

del collector

实验结果¶

我们制作了一个训练期间平均奖励的简单图表。可以观察到我们的策略很好地学会了完成任务。

备注

如上所述,为了获得更合理的性能,请使用较大的``total_frames``值,例如1百万。

from matplotlib import pyplot as plt

plt.figure()

plt.plot(*zip(*rewards), label="training")

plt.plot(*zip(*rewards_eval), label="eval")

plt.legend()

plt.xlabel("iter")

plt.ylabel("reward")

plt.tight_layout()

总结¶

在本教程中,我们学习了如何在TorchRL中编码一个损失模块,以DDPG为具体示例。

关键要点是:

如何使用:class:`~torchrl.objectives.LossModule`类来编写一个新的损失组件;

如何使用(或不使用)目标网络,以及如何更新其参数;

如何创建与损失模块关联的优化器。

接下来的步骤¶

为了进一步完善该损失模块,我们可以考虑:

使用`@dispatch`(参见`[Feature] Dispatch IQL loss module <https://github.com/pytorch/rl/pull/1230>`_)

允许灵活的TensorDict键。