备注

点击 此处 下载完整示例代码

(测试版) 使用半结构化(2:4)稀疏加速BERT¶

Created On: Apr 22, 2024 | Last Updated: Mar 20, 2025 | Last Verified: Nov 05, 2024

作者: Jesse Cai

概述¶

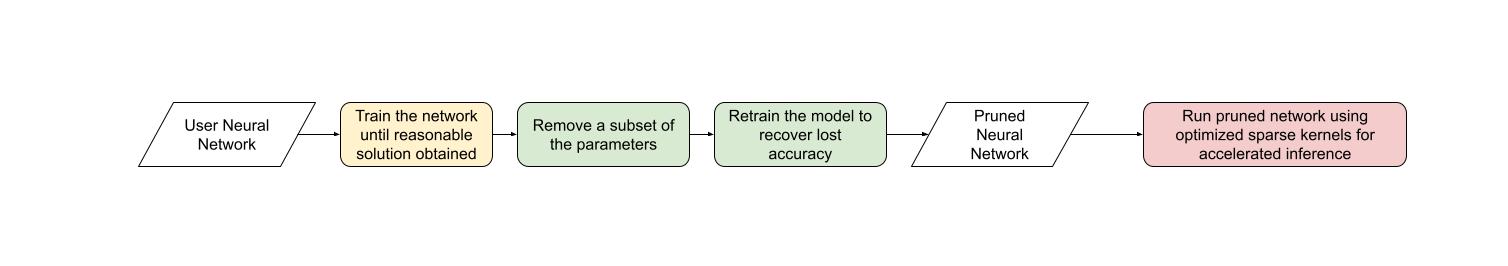

与其他形式的稀疏性类似,半结构化稀疏**是一种模型优化技术,其目的是在提升模型效率的同时,以牺牲一定的模型准确率为代价降低神经网络的内存开销和延迟。它也被称为**精细粒度结构化稀疏**或**2:4结构化稀疏。

半结构化稀疏因其独特的稀疏模式而得名,其中每2n个元素中有n个被剪枝。最常见的是n=2,即2:4稀疏。半结构化稀疏之所以特别有趣,是因为它可以在GPU上高效加速,并且其对模型准确率的影响比其他稀疏模式更小。

随着对 半结构化稀疏支持 的引入,现在可以在完全使用PyTorch的情况下剪枝并加速半结构化稀疏模型。在本教程中,我们将解释这一过程。

在本教程结束时,我们将把一个BERT问答模型稀疏化为2:4稀疏,对其进行微调以恢复几乎所有F1损失(86.92稠密模型对比86.48稀疏模型)。最后,我们将加速该2:4稀疏模型进行推断,实现1.3倍速度提升。

需求¶

PyTorch >= 2.1。

支持半结构化稀疏的NVIDIA GPU(计算能力8.0+)。

本教程面向半结构化稀疏和稀疏性的初学者设计。对于已有2:4稀疏模型的用户,用``to_sparse_semi_structured``加速``nn.Linear``层进行推断非常简单。以下是一个示例:

import torch

from torch.sparse import to_sparse_semi_structured, SparseSemiStructuredTensor

from torch.utils.benchmark import Timer

SparseSemiStructuredTensor._FORCE_CUTLASS = True

# mask Linear weight to be 2:4 sparse

mask = torch.Tensor([0, 0, 1, 1]).tile((3072, 2560)).cuda().bool()

linear = torch.nn.Linear(10240, 3072).half().cuda().eval()

linear.weight = torch.nn.Parameter(mask * linear.weight)

x = torch.rand(3072, 10240).half().cuda()

with torch.inference_mode():

dense_output = linear(x)

dense_t = Timer(stmt="linear(x)",

globals={"linear": linear,

"x": x}).blocked_autorange().median * 1e3

# accelerate via SparseSemiStructuredTensor

linear.weight = torch.nn.Parameter(to_sparse_semi_structured(linear.weight))

sparse_output = linear(x)

sparse_t = Timer(stmt="linear(x)",

globals={"linear": linear,

"x": x}).blocked_autorange().median * 1e3

# sparse and dense matmul are numerically equivalent

# On an A100 80GB, we see: `Dense: 0.870ms Sparse: 0.630ms | Speedup: 1.382x`

assert torch.allclose(sparse_output, dense_output, atol=1e-3)

print(f"Dense: {dense_t:.3f}ms Sparse: {sparse_t:.3f}ms | Speedup: {(dense_t / sparse_t):.3f}x")

半结构化稀疏解决了什么问题?¶

稀疏性的基本动机很简单:如果网络中存在零值,则通过不存储或计算这些参数来优化效率。然而,稀疏性的具体细节非常棘手。只对参数置零本身并不会显著减少模型的延迟或内存开销。

这是因为稠密张量仍然包含剪枝(零值)元素,稠密矩阵乘法内核仍会在这些元素上运算。为了实现性能提升,我们需要将稠密内核换成稀疏内核,这些稀疏内核会跳过与剪枝元素相关的计算。

为此,这些内核处理稀疏矩阵,稀疏矩阵不存储剪枝元素,而以压缩格式存储指定的元素。

对于半结构化稀疏性,我们存储了原始参数的一半,以及一些关于元素排列的压缩元数据。

有许多不同的稀疏布局,每种布局都有其自身的优点和缺点。2:4半结构化稀疏布局特别引人注目有两个原因:

与之前的稀疏格式不同,半结构化稀疏性设计为能够在GPU上高效加速。2020年,NVIDIA通过其Ampere架构引入了对半结构化稀疏性的硬件支持,并通过CUTLASS发布了快速稀疏内核 cuSPARSELt。

同时,与其他稀疏格式相比,半结构化稀疏性对模型准确性的影响较小,特别是在考虑更高级的剪枝/微调方法时。NVIDIA在其 白皮书 中显示,通过一次简单的幅度剪枝使模型达到2:4稀疏并重新训练模型后,可获得几乎相同的模型准确性。

半结构化稀疏性处于甜蜜点,在一个较低的稀疏水平(50%)提供了2倍(理论上)加速,同时仍然具备足够的细粒度以保留模型准确性。

网络 |

数据集 |

度量指标 |

Dense FP16 |

Sparse FP16 |

|---|---|---|---|---|

ResNet-50 |

ImageNet |

Top-1 |

76.1 |

76.2 |

ResNeXt-101_32x8d |

ImageNet |

Top-1 |

79.3 |

79.3 |

Xception |

ImageNet |

Top-1 |

79.2 |

79.2 |

SSD-RN50 |

COCO2017 |

bbAP |

24.8 |

24.8 |

MaskRCNN-RN50 |

COCO2017 |

bbAP |

37.9 |

37.9 |

FairSeq Transformer |

EN-DE WMT14 |

BLEU |

28.2 |

28.5 |

BERT-Large |

SQuAD v1.1 |

F1 |

91.9 |

91.9 |

从工作流程角度来看,半结构化稀疏性具有额外的优势。由于稀疏水平固定为50%,将模型稀疏化的问题分解为两个不同的子问题变得更加容易:

准确性 - 我们如何找到一组2:4稀疏权重以最小化模型的准确性下降?

性能 - 我们如何加速模型推理并减少内存开销的2:4稀疏权重?

这两个问题之间的自然交接点是被清零的密集张量。我们的推理解决方案旨在压缩并加速这种格式的张量。我们预计许多用户将提出定制的掩码解决方案,因为这是一个活跃的研究领域。

现在我们已经更多了解了半结构化稀疏性,让我们将它应用到一个训练在问答任务SQuAD上的BERT模型中。

介绍与设置¶

让我们先导入所有需要的包。

# If you are running this in Google Colab, run:

# .. code-block: python

#

# !pip install datasets transformers evaluate accelerate pandas

#

import os

os.environ["WANDB_DISABLED"] = "true"

import collections

import datasets

import evaluate

import numpy as np

import torch

import torch.utils.benchmark as benchmark

from torch import nn

from torch.sparse import to_sparse_semi_structured, SparseSemiStructuredTensor

from torch.ao.pruning import WeightNormSparsifier

import transformers

# force CUTLASS use if ``cuSPARSELt`` is not available

SparseSemiStructuredTensor._FORCE_CUTLASS = True

torch.manual_seed(100)

# Set default device to "cuda:0"

torch.set_default_device(torch.device("cuda:0" if torch.cuda.is_available() else "cpu"))

我们还需要定义一些特定于数据集/任务的辅助函数。这些函数是从 此处 的Hugging Face课程中改编而来的参考。

def preprocess_validation_function(examples, tokenizer):

inputs = tokenizer(

[q.strip() for q in examples["question"]],

examples["context"],

max_length=384,

truncation="only_second",

return_overflowing_tokens=True,

return_offsets_mapping=True,

padding="max_length",

)

sample_map = inputs.pop("overflow_to_sample_mapping")

example_ids = []

for i in range(len(inputs["input_ids"])):

sample_idx = sample_map[i]

example_ids.append(examples["id"][sample_idx])

sequence_ids = inputs.sequence_ids(i)

offset = inputs["offset_mapping"][i]

inputs["offset_mapping"][i] = [

o if sequence_ids[k] == 1 else None for k, o in enumerate(offset)

]

inputs["example_id"] = example_ids

return inputs

def preprocess_train_function(examples, tokenizer):

inputs = tokenizer(

[q.strip() for q in examples["question"]],

examples["context"],

max_length=384,

truncation="only_second",

return_offsets_mapping=True,

padding="max_length",

)

offset_mapping = inputs["offset_mapping"]

answers = examples["answers"]

start_positions = []

end_positions = []

for i, (offset, answer) in enumerate(zip(offset_mapping, answers)):

start_char = answer["answer_start"][0]

end_char = start_char + len(answer["text"][0])

sequence_ids = inputs.sequence_ids(i)

# Find the start and end of the context

idx = 0

while sequence_ids[idx] != 1:

idx += 1

context_start = idx

while sequence_ids[idx] == 1:

idx += 1

context_end = idx - 1

# If the answer is not fully inside the context, label it (0, 0)

if offset[context_start][0] > end_char or offset[context_end][1] < start_char:

start_positions.append(0)

end_positions.append(0)

else:

# Otherwise it's the start and end token positions

idx = context_start

while idx <= context_end and offset[idx][0] <= start_char:

idx += 1

start_positions.append(idx - 1)

idx = context_end

while idx >= context_start and offset[idx][1] >= end_char:

idx -= 1

end_positions.append(idx + 1)

inputs["start_positions"] = start_positions

inputs["end_positions"] = end_positions

return inputs

def compute_metrics(start_logits, end_logits, features, examples):

n_best = 20

max_answer_length = 30

metric = evaluate.load("squad")

example_to_features = collections.defaultdict(list)

for idx, feature in enumerate(features):

example_to_features[feature["example_id"]].append(idx)

predicted_answers = []

# for example in ``tqdm`` (examples):

for example in examples:

example_id = example["id"]

context = example["context"]

answers = []

# Loop through all features associated with that example

for feature_index in example_to_features[example_id]:

start_logit = start_logits[feature_index]

end_logit = end_logits[feature_index]

offsets = features[feature_index]["offset_mapping"]

start_indexes = np.argsort(start_logit)[-1 : -n_best - 1 : -1].tolist()

end_indexes = np.argsort(end_logit)[-1 : -n_best - 1 : -1].tolist()

for start_index in start_indexes:

for end_index in end_indexes:

# Skip answers that are not fully in the context

if offsets[start_index] is None or offsets[end_index] is None:

continue

# Skip answers with a length that is either < 0

# or > max_answer_length

if (

end_index < start_index

or end_index - start_index + 1 > max_answer_length

):

continue

answer = {

"text": context[

offsets[start_index][0] : offsets[end_index][1]

],

"logit_score": start_logit[start_index] + end_logit[end_index],

}

answers.append(answer)

# Select the answer with the best score

if len(answers) > 0:

best_answer = max(answers, key=lambda x: x["logit_score"])

predicted_answers.append(

{"id": example_id, "prediction_text": best_answer["text"]}

)

else:

predicted_answers.append({"id": example_id, "prediction_text": ""})

theoretical_answers = [

{"id": ex["id"], "answers": ex["answers"]} for ex in examples

]

return metric.compute(predictions=predicted_answers, references=theoretical_answers)

既然定义完这些函数,我们只需要再定义一个辅助函数来帮助我们基准测试我们的模型。

def measure_execution_time(model, batch_sizes, dataset):

dataset_for_model = dataset.remove_columns(["example_id", "offset_mapping"])

dataset_for_model.set_format("torch")

batch_size_to_time_sec = {}

for batch_size in batch_sizes:

batch = {

k: dataset_for_model[k][:batch_size].cuda()

for k in dataset_for_model.column_names

}

with torch.no_grad():

baseline_predictions = model(**batch)

timer = benchmark.Timer(

stmt="model(**batch)", globals={"model": model, "batch": batch}

)

p50 = timer.blocked_autorange().median * 1000

batch_size_to_time_sec[batch_size] = p50

model_c = torch.compile(model, fullgraph=True)

timer = benchmark.Timer(

stmt="model(**batch)", globals={"model": model_c, "batch": batch}

)

p50 = timer.blocked_autorange().median * 1000

batch_size_to_time_sec[f"{batch_size}_compile"] = p50

new_predictions = model_c(**batch)

return batch_size_to_time_sec

我们将从加载模型和标记器开始,然后设置数据集。

# load model

model_name = "bert-base-cased"

tokenizer = transformers.AutoTokenizer.from_pretrained(model_name)

model = transformers.AutoModelForQuestionAnswering.from_pretrained(model_name)

print(f"Loading tokenizer: {model_name}")

print(f"Loading model: {model_name}")

# set up train and val dataset

squad_dataset = datasets.load_dataset("squad")

tokenized_squad_dataset = {}

tokenized_squad_dataset["train"] = squad_dataset["train"].map(

lambda x: preprocess_train_function(x, tokenizer), batched=True

)

tokenized_squad_dataset["validation"] = squad_dataset["validation"].map(

lambda x: preprocess_validation_function(x, tokenizer),

batched=True,

remove_columns=squad_dataset["train"].column_names,

)

data_collator = transformers.DataCollatorWithPadding(tokenizer=tokenizer)

建立基准¶

接下来,我们将在SQuAD上快速训练模型的基准。这项任务要求我们的模型在给定的上下文(维基百科文章)中识别回答某个问题的文本片段或段落。运行以下代码可以得到一个F1分数为86.9。这非常接近NVIDIA报告的分数,差异可能是由于BERT-base与BERT-large或者微调超参数的不同。

training_args = transformers.TrainingArguments(

"trainer",

num_train_epochs=1,

lr_scheduler_type="constant",

per_device_train_batch_size=32,

per_device_eval_batch_size=256,

logging_steps=50,

# Limit max steps for tutorial runners. Delete the below line to see the reported accuracy numbers.

max_steps=500,

report_to=None,

)

trainer = transformers.Trainer(

model,

training_args,

train_dataset=tokenized_squad_dataset["train"],

eval_dataset=tokenized_squad_dataset["validation"],

data_collator=data_collator,

tokenizer=tokenizer,

)

trainer.train()

# batch sizes to compare for eval

batch_sizes = [4, 16, 64, 256]

# 2:4 sparsity require fp16, so we cast here for a fair comparison

with torch.autocast("cuda"):

with torch.no_grad():

predictions = trainer.predict(tokenized_squad_dataset["validation"])

start_logits, end_logits = predictions.predictions

fp16_baseline = compute_metrics(

start_logits,

end_logits,

tokenized_squad_dataset["validation"],

squad_dataset["validation"],

)

fp16_time = measure_execution_time(

model,

batch_sizes,

tokenized_squad_dataset["validation"],

)

print("fp16", fp16_baseline)

print("cuda_fp16 time", fp16_time)

import pandas as pd

df = pd.DataFrame(trainer.state.log_history)

df.plot.line(x='step', y='loss', title="Loss vs. # steps", ylabel="loss")

将BERT剪枝为2:4稀疏¶

现在我们有了基线,是时候剪枝BERT了。有许多不同的剪枝策略,但最常见的一种是**幅度剪枝**,它试图移除具有最低L1范数的权重。NVIDIA在所有结果中使用了幅度剪枝,这也是一种常见的基线。

为此,我们将使用``torch.ao.pruning``包,该包包含一个权重范数(幅度)稀疏器。这些稀疏器通过对模型中的权重张量应用掩码参数化来工作。这使它们能够通过屏蔽剪枝权重来模拟稀疏性。

我们还需要决定将稀疏性应用于模型的哪些层,在这种情况下,是除了任务特定的头部输出之外的所有``nn.Linear``层。这是因为半结构化稀疏性具有`形状约束 <https://pytorch.org/docs/2.1/sparse.html#constructing-sparse-semi-structured-tensors>`_,而任务特定的``nn.Linear``层不满足这些约束。

sparsifier = WeightNormSparsifier(

# apply sparsity to all blocks

sparsity_level=1.0,

# shape of 4 elements is a block

sparse_block_shape=(1, 4),

# two zeros for every block of 4

zeros_per_block=2

)

# add to config if ``nn.Linear`` and in the BERT model.

sparse_config = [

{"tensor_fqn": f"{fqn}.weight"}

for fqn, module in model.named_modules()

if isinstance(module, nn.Linear) and "layer" in fqn

]

剪枝模型的第一步是插入掩码化参数化,用于掩盖模型权重。这通过准备步骤完成。任何时候我们尝试访问``.weight``,我们将获取``mask * weight``。

# Prepare the model, insert fake-sparsity parametrizations for training

sparsifier.prepare(model, sparse_config)

print(model.bert.encoder.layer[0].output)

然后,我们将进行单个剪枝步骤。所有剪枝器都实现了一个``update_mask()``方法,使用剪枝器实现定义的逻辑更新掩码。步骤方法调用此``update_mask``函数,针对稀疏配置中指定的权重。

我们还将评估模型,以展示零样本剪枝(即无微调/重新训练剪枝)的准确性下降。

sparsifier.step()

with torch.autocast("cuda"):

with torch.no_grad():

predictions = trainer.predict(tokenized_squad_dataset["validation"])

pruned = compute_metrics(

*predictions.predictions,

tokenized_squad_dataset["validation"],

squad_dataset["validation"],

)

print("pruned eval metrics:", pruned)

在这种状态下,我们可以开始微调模型,更新不会被剪枝的元素以更好地补偿准确性损失。一旦达到满意的状态,我们可以调用``squash_mask``来将掩码和权重合并在一起。这将删除参数化,我们得到一个被清零的2:4密集模型。

trainer.train()

sparsifier.squash_mask()

torch.set_printoptions(edgeitems=4)

print(model.bert.encoder.layer[0].intermediate.dense.weight[:8, :8])

df["sparse_loss"] = pd.DataFrame(trainer.state.log_history)["loss"]

df.plot.line(x='step', y=["loss", "sparse_loss"], title="Loss vs. # steps", ylabel="loss")

加速2:4稀疏模型的推理¶

现在我们有了这种格式的模型,我们可以像快速入门指南中一样加速其推理性能。

model = model.cuda().half()

# accelerate for sparsity

for fqn, module in model.named_modules():

if isinstance(module, nn.Linear) and "layer" in fqn:

module.weight = nn.Parameter(to_sparse_semi_structured(module.weight))

with torch.no_grad():

predictions = trainer.predict(tokenized_squad_dataset["validation"])

start_logits, end_logits = predictions.predictions

metrics_sparse = compute_metrics(

start_logits,

end_logits,

tokenized_squad_dataset["validation"],

squad_dataset["validation"],

)

print("sparse eval metrics: ", metrics_sparse)

sparse_perf = measure_execution_time(

model,

batch_sizes,

tokenized_squad_dataset["validation"],

)

print("sparse perf metrics: ", sparse_perf)

在幅度剪枝后重新训练我们的模型已恢复几乎所有剪枝时丢失的F1分数。同时,对于``bs=16``我们实现了1.28倍的加速。请注意,并非所有形状都适合性能改进。在批量大小较小且计算稀疏内核的时间有限时,稀疏内核可能比其密集对应物更慢。

由于半结构化稀疏性作为张量子类实现,它与``torch.compile``是兼容的。当与``to_sparse_semi_structured``组合时,我们能够在BERT上实现总计2倍的加速。

指标 |

fp16 |

2:4稀疏 |

变化 / 加速 |

已编译 |

|---|---|---|---|---|

精确匹配率(%) |

78.53 |

78.44 |

-0.09 |

|

F1(%) |

86.93 |

86.49 |

-0.44 |

|

时间(bs=4) |

11.10 |

15.54 |

0.71x |

否 |

时间(bs=16) |

19.35 |

15.74 |

1.23x |

否 |

时间(bs=64) |

72.71 |

59.41 |

1.22x |

否 |

时间(bs=256) |

286.65 |

247.63 |

1.14x |

否 |

时间(bs=4) |

7.59 |

7.46 |

1.02x |

是 |

时间(bs=16) |

11.47 |

9.68 |

1.18x |

是 |

时间(bs=64) |

41.57 |

36.92 |

1.13x |

是 |

时间(bs=256) |

159.22 |

142.23 |

1.12x |

是 |

总结¶

在本教程中,我们展示了如何将BERT剪枝为2:4稀疏以及如何加速2:4稀疏模型的推理性能。通过利用我们的``SparseSemiStructuredTensor``子类,我们比fp16基线实现了1.3倍的加速,并通过``torch.compile``实现了最高2倍的加速。我们还通过微调BERT展示了2:4稀疏性的优势,以恢复任何丢失的F1(86.92密集与86.48稀疏)。